Cho trẻ xem YouTube một mình chẳng khác nào ném con mình vào tay những kẻ bệnh hoạn đã tạo ra Thử thách Momo

Nếu bạn thực sự hiểu bản chất và cơ chế hoạt động của YouTube, bạn cũng sẽ nhận ra một sự thật đau lòng: cho trẻ thoải mái xem video một mình trên điện thoại cũng chẳng khác nào ném con mình vào vòng tay của những kẻ bệnh hoạn đã tạo ra Thử Thách Momo.

Những ngày này, các bậc cha mẹ đang phải lo lắng hơn bao giờ hết. Chèn giữa và thậm chí là ngay bên trong các đoạn video dành cho trẻ nhỏ là những hình ảnh kinh dị của "Thử thách Momo", nơi một con quái vật có tạo hình ám ảnh lên tiếng đe dọa và khuyến khích trẻ nhỏ thực hiện các hành vi tự hại.

Tác hại đã không chỉ dừng ở mức độ tâm lý: tháng 7/2018, một đứa trẻ ở Argentina được cho là đã treo cổ tự tử ở sân sau nhà mình như một phần của Thử thách Momo. Một bé gái 12 tuổi và một thiếu niên 16 tuổi khác cũng trở thành nạn nhân của trò đùa ác độc này chỉ vài tháng sau đó.

Xem YouTube dẫn đến cái chết, liệu có phải là một bất ngờ đáng sửng sốt hay không?

Không hề. Tác hại khủng khiếp của Momo chỉ là bề nổi của tảng băng. Trước và sau scandal này, YouTube sẽ luôn luôn là sân chơi của những kẻ bệnh hoạn sẵn sàng làm hại con cái của bạn.

Vì kẻ xấu thì lúc nào cũng có, còn YouTube thì chưa bao giờ là một dịch vụ, một nền tảng hướng về con người, do con người chịu trách nhiệm. Theo đúng phong cách hoạt động truyền thống của công ty mẹ Google, YouTube là một dịch vụ có mức độ tự động hóa cực cao. Việc tìm nội dung xấu và tạm ngưng nội dung xấu trước tiên là do máy móc (thuật toán) đảm nhận.

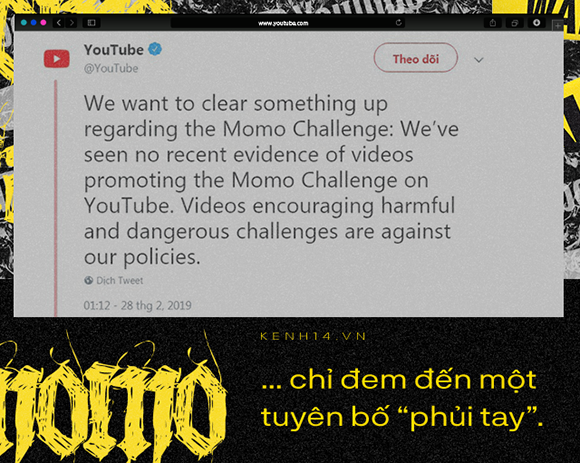

Mà những cỗ máy, cho dù có tân tiến đến mấy, vẫn thua kém con người về khả năng phát hiện nội dung xấu. Đến Google còn để lọt mã độc lên cửa hàng ứng dụng Google Play, thì làm sao mà YouTube lại không để lọt video biến tướng? Mới gần đây, chính mạng chia sẻ này còn đã lên tiếng chối bỏ trách nhiệm: "Chúng tôi không tìm thấy bằng chứng của video cổ súy Thử thách Momo trên YouTube".

Sự chối bỏ ấy không phải là một lời nói dối, mà đơn giản là vì YouTube thực sự bất lực. Bởi dịch vụ này hoạt động trên những thuật toán nhuần nhuyễn, mỗi khi có ai đó than phiền thì Google sẽ lại thực hiện lại điều duy nhất họ có thể làm từ trước tới nay: chạy một thuật toán tự động nào đó để nhận diện các nội dung xấu (chứ không phải là thuê người xem loại toàn bộ nội dung video đã đăng tải). Các thuật toán ấy tất yếu lại thất bại, và YouTube nói ra điều ai ai cũng đã biết: "không tìm thấy dấu vết".

Vì YouTube không thể tự lọc trước được nội dung xấu, việc trẻ em tiếp xúc với Thử Thách Momo hay Thử thách Cá voi xanh là gần như chắc chắn sẽ xảy ra. Những người dùng YouTube lâu năm biết rằng mạng chia sẻ này sẽ dựa trên tiêu đề, dựa trên mô tả để gợi ý video này tiếp theo video khác. Qua cơ chế đó, những nội dung Peppa Pig hay Fortnite có chèn Thử thách Momo sẽ xuất hiện đan xen bên cạnh những đoạn video Peppa Pig hay Fortnite bình thường, vô hại.

Đâu phải đến bây giờ những chuyện tương tự như thế này mới xảy ra: có những đứa bé say mê xem video tàu hỏa chỉ để được YouTube gợi ý một đoạn video có nội dung là tai nạn đường ray thảm khốc. Có những đứa bé say mê xem bài hát thiếu nhi chỉ để được YouTube gợi ý những bài nhạc chế chứa đầy những từ ngữ, hình ảnh phản cảm. Video Elsa được nối tiếp bởi video có hình ảnh các cô công chúa Disney... thiếu vải, vlog dễ thương của các blogger "nhí" có thể được nối tiếp bởi các vlog lố bịch, phản cảm.

Và đó là còn chưa tính đến vô số những bình luận không có ai kiểm soát. Những kẻ ấu dâm được cho là đã sử dụng hệ thống comment của YouTube làm nơi trao đổi thông tin và xâm hại các em một cách công khai.

Nếu thực sự có trách nhiệm, YouTube sẽ "đánh phủ đầu" kẻ xấu, sẽ phải thuê nhân sự kiểm duyệt từng video, từng bình luận đăng tải. Nhưng thuê bao nhiêu người để đủ theo dõi từng giây nội dung được đăng lên YouTube, để đọc từng comment nặc danh? Để tiết kiệm chi phí, YouTube – và tất cả các mạng xã hội khác – đều chờ đợi có ai báo cáo video nội dung xấu rồi mới đưa người vào giải quyết.

Một lần nữa, "giải pháp" ấy không thể giải quyết được vấn đề, vì đâu phải ai thấy nội dung xấu rồi cũng sẽ thông báo cho YouTube. Điều gì sẽ xảy ra khi các em nhỏ là đối tượng đầu tiên tiếp xúc với những nội dung xấu này? Những em nhỏ đã tự hại vì Momo, chúng đâu có nói với người lớn?

Nếu để ý, bạn sẽ thấy YouTube không hề muốn thay đổi. Những biện pháp tình thế như tắt tính năng bình luận trên các video trẻ em vẫn sẽ quay lại vấn đề cốt lõi của YouTube: ai là người phân biệt video nào là Peppa Pig cho trẻ em, và video nào là Peppa Pig "chế", Peppa Pig có chửi thề, Peppa Pig có chứa hình ảnh Momo? Tuyên bố nào của YouTube cũng vậy, nghe bề nổi thì hợp lý, nhưng cuối cùng vẫn không giải quyết triệt để được vấn đề: đó vẫn là một cỗ máy với những thuật toán không thể nào tinh xảo như mắt người.

Mà trẻ em thì không phải những cỗ máy. Chúng là những tâm hồn nhạy cảm. Theo một chuyên gia an ninh mạng, Thử thách Momo cũng như Thử thách Cá voi xanh đã cướp đi mạng sống của 130 đứa trẻ tại Nga. Những tâm hồn nhạy cảm ấy cần 1 giải pháp triệt để hoàn toàn, bởi chỉ để lọt 1 video cũng là 1 chấn thương tâm lý ảnh hưởng đến cả cuộc đời của con trẻ.

Chỉ có một đường để đi mà thôi: hãy ngừng trông chờ YouTube có trách nhiệm với trẻ em. Trách nhiệm ấy thuộc về bố mẹ. Các bậc phụ huynh phải xem lại con mình đã xem gì trên YouTube. Nếu không cấm con xem YouTube, các bậc phụ huynh phải là bộ lọc thời gian thực, theo dõi con trong lúc con đang xem video. Kẻ xấu thì lúc nào cũng có, bản chất, cơ chế hoạt động của YouTube thì mãi mãi không bao giờ thay đổi. Nếu bạn để cho con ngồi xem YouTube một mình trên điện thoại hay iPad, câu chuyện Momo sớm hay muộn gì cũng sẽ xảy ra với con bạn mà thôi.